輝達法說變法會?盤後逾5%漲幅吐光光 黃仁勳說了什麼全紀錄

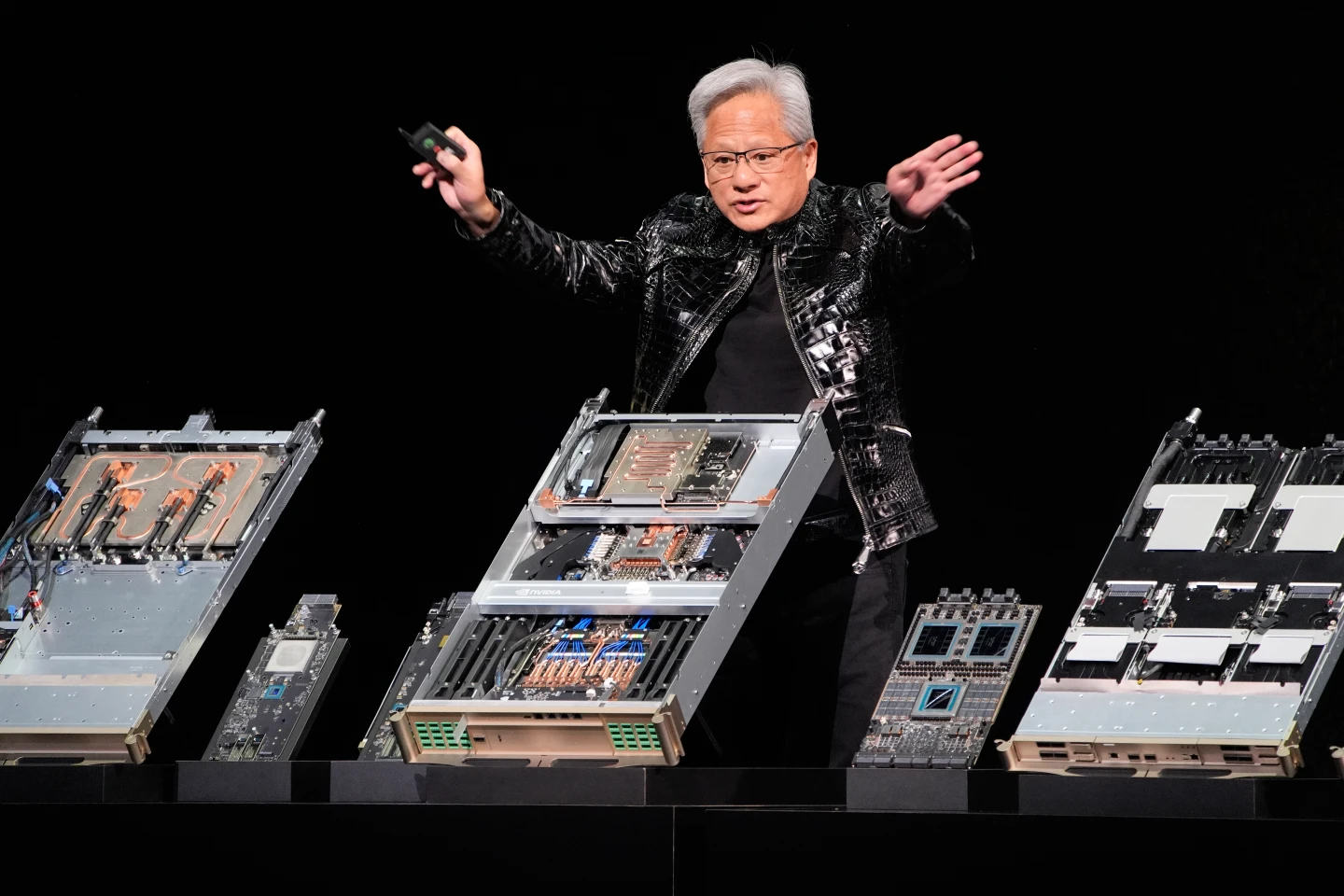

【編譯于倩若/綜合外電】輝達(Nvidia)今晨公布財報顯示,上季營收與獲利優於市場預期,對本季營收預測為「780億美元上下浮動2%」,遠高於市場預期的727.8億美元,在第一時間激勵其股價於盤後交易大漲超過5%,不過隨著輝達進入法說會環節,其漲幅大幅收窄並翻黑小跌,原本受到輝達激勵的台積電ADR、博通與美光股價也都跟著轉為下跌。執行長黃仁勳與財務長Colette Kress在法說會上到底說了什麼?《知新聞》為您完整記錄。

Blackwell+Rubin營收0.5兆美元破表可期 美批准H200出口中國尚未產生任何營收

財務長Colette Kress法說會上打頭陣先說明各部門業績狀況,她表示輝達在年度第4季再次交出非常亮眼的季度成績,營收、營業利益與自由現金流都創下歷史新高。

上季總營收為680億美元,年增73%,較前季進一步加速成長。

以季增來看同樣創下新高,輝達在資料中心業務新增110億美元營收,客戶群涵蓋雲端服務供應商、超大規模業者(hyperscalers)、AI模型開發商、企業客戶以及主權國家,結構多元且持續擴大。

輝達的Blackwell架構,在資料中心規模下進行極致共同設計(extreme codesign),隨著推論(inference)部署持續成長、並行於訓練需求之上,需求不斷增強。

加速運算的轉型,以及AI導入既有超大規模工作負載,持續成為輝達成長的動能。

建立在愈來愈聰明、且具多模態能力模型之上的代理式 AI(Agentic AI)與實體AI(Physical AI)應用,已開始對輝達財務表現產生實質貢獻。

以全年來看,資料中心營收達1940 億美元,年增68%。自2023財年ChatGPT問世以來,我們的資料中心業務規模已擴大近13倍。

她表示,展望未來,輝達預期今年將呈現逐季營收成長,並超越去年所分享的Blackwell與Rubin合計5000億美元營收機會。

她透露輝達目前已備妥庫存與供應承諾,足以支應未來需求,出貨時程甚至延伸至2027年。

目前所有資料中心都面臨電力受限問題。在這樣的限制條件下,加上必須最大化AI工廠營收的需求,客戶會依據「每瓦效能」(performance per watt)做出關鍵架構決策。

Colette Kress提到,SemiAnalysis將輝達稱為「推論之王」。InferenceX的最新結果再次強化輝達在推論領域的領導地位,GB300與NVL72在每瓦效能上最高可達50倍提升,每個token成本降低35倍,相較其他方案具顯著優勢。

CUDA軟體持續優化,在短短4個月內,讓GV200與NVL72的效能最高提升5倍。

輝達提供業界最低的每token成本,而運行輝達架構的資料中心可創造最高營收。

Colette Kress自豪地說,輝達的創新速度,尤其在如此規模之下,無人能及。

在接近200億美元的年度研發預算支持下,加上輝達在晶片、系統、演算法與軟體、橫跨運算與網路領域的極致共同設計能力,輝達計劃在每一代產品都實現倍數級的每瓦效能躍升,並長期延續領導地位。

第4季度資料中心營收為620億美元,年增 75%、季增22%,主要來自Blackwell與Blackwell Ultra持續放量的強勁動能。

在輝達基礎設施需求極高的情況下,即使是Hopper與多數6年前推出、基於Ampere架構的產品,在雲端也已售罄。

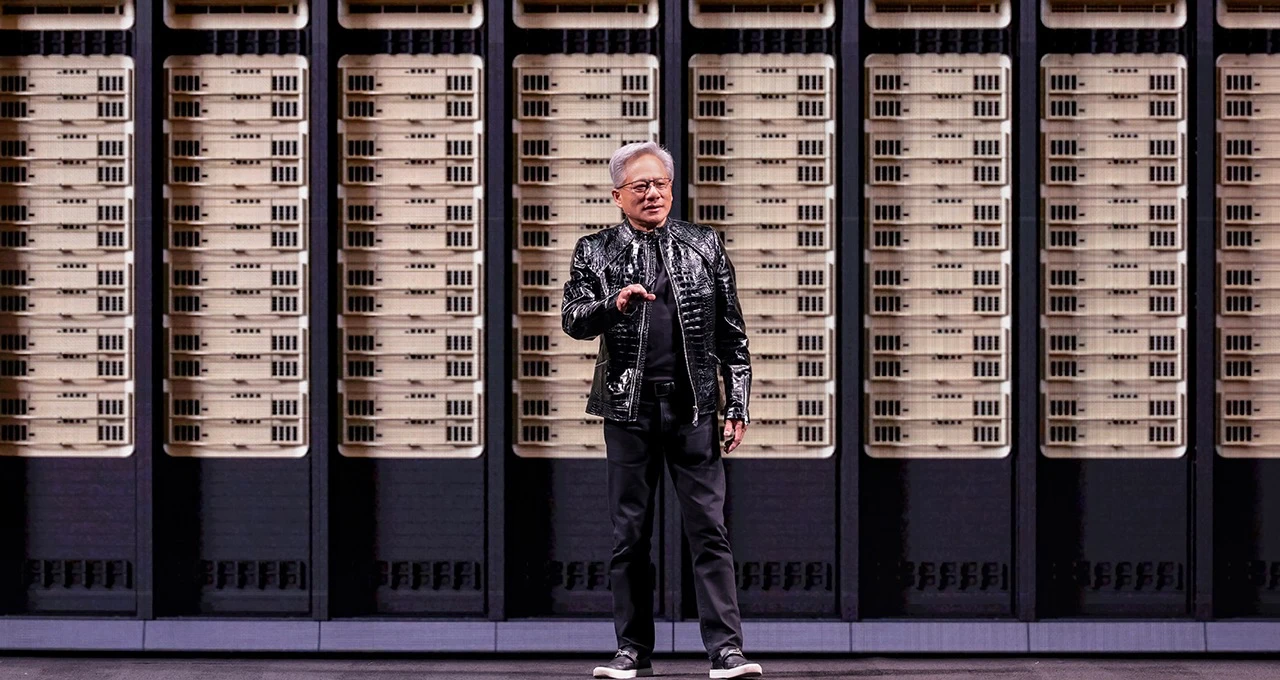

自Grace Blackwell GB200 NVL72系統推出至今將近1年,目前已有近9GW的Blackwell基礎設施完成部署,並被主要雲端服務供應商、超大規模業者、AI 模型開發商與企業客戶採用。

Networking作為輝達資料中心規模基礎設施方案的核心,上季表現突出,營收達110億美元,年增超過3.5倍。

輝達的scale-up與scale-out技術需求創下歷史新高,兩者皆呈現雙位數季增,主要來自NVL72 scale-up交換器的強勁採用。本季Grace Blackwell系統約佔資料中心營收的3分之2。

NVLink scale-up fabric改變了運算方式,展現了在超級電腦所有晶片與完整軟體堆疊上的極致共同設計威力。

第4季輝達宣布將透過NVLink協助亞馬遜AWS整合其自研晶片。

Spectrum X Ethernet在scale-up與scale-across架構上動能強勁,協助客戶將分散式資料中心整合為整體式、超大規模AI工廠。

全年Networking營收超過310億美元,較2021財年(輝達收購Mellanox的那一年)成長超過10倍。

輝達的需求結構廣泛、多元,並已超越聊天機器人。

首先,是從傳統機器學習轉向生成式AI的根本性平台轉變。

Colette Kress指出,當超大規模業者將搜尋、廣告生成、內容推薦系統等傳統龐大工作負載升級為生成式AI,並展現強勁ROI證據時,這正在鼓勵輝達最大的客戶加速資本支出。

例如在Meta,其GEM模型的進展,使臉書廣告點擊率提升3.5倍,Instagram轉換率提升超過1%,轉化為實質營收成長。

在相同的輝達基礎設施上,Meta Superintelligence Labs可訓練並部署其前沿代理式AI系統。

前沿代理式系統已達到拐點。

Claude Code、Claude Cowork與OpenAI Codex已達到實用智慧水準。

採用率急速攀升,token已具獲利能力,帶動運算擴張的高度急迫性。運算直接轉化為智慧與營收成長。

分析師對2026年前5大雲端與超大規模業者的資本支出預估,這些客戶合計佔我們資料中心營收略高於50%,自年初以來上調近1200億美元,接近7000億美元。

輝達仍預期,傳統資料中心工作負載轉向GPU加速運算,以及AI強化既有超大規模工作負載,將貢獻輝達長期機會約一半。

每個國家都將建立並營運其AI基礎設施的一部分,就如同今日的電力與網路。

在2026財年(截至2026年1月底),輝達的主權AI業務年增超過3倍,達到300億美元以上,主要來自加拿大、法國、荷蘭、新加坡與英國客戶。

長期來看,輝達預期主權機會將至少與AI基礎設施市場同步成長,因為各國對AI的支出將與其GDP成比例。

雖然少量H200產品已獲美國政府批准供應中國客戶,但目前尚未產生任何營收,且我們仍不確定未來是否會允許進口至中國。

中國競爭對手在近期IPO支持下持續進展,長期可能對全球AI產業結構造成衝擊。

若美國要維持AI運算領導地位,必須吸引每一位開發者,成為所有商業企業的首選平台,包括中國企業。

輝達將持續與美中兩國政府溝通,倡議美國在全球競爭的能力。

輝達首批Vera Rubin樣品出貨,量產計畫仍鎖定今年下半年

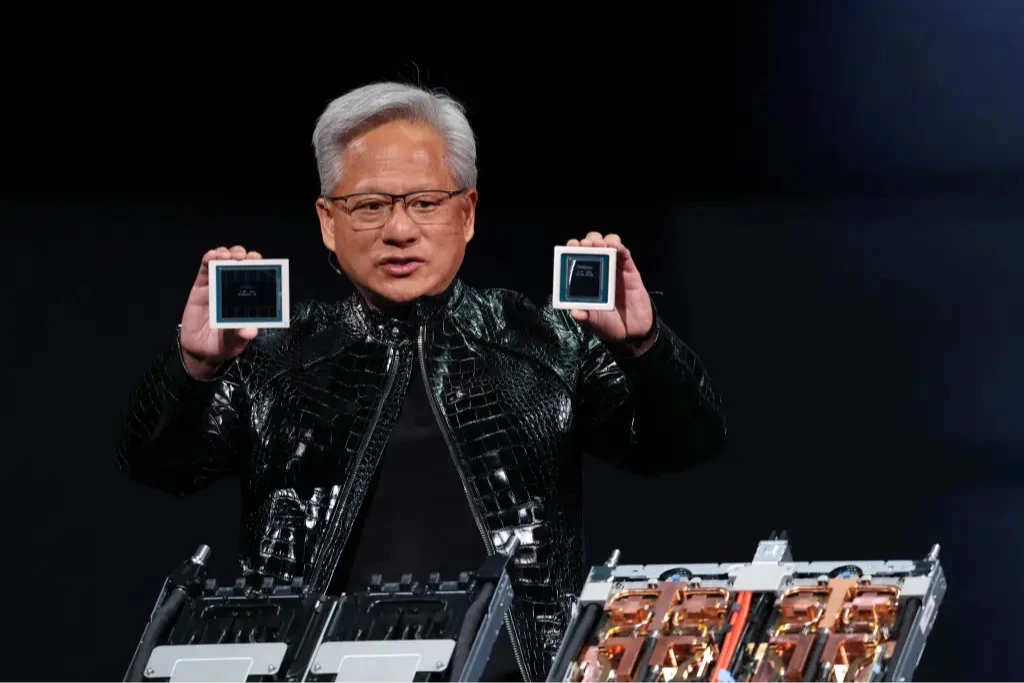

Colette Kress接著表示,輝達上月在CES發表了Rubin平台,由6顆新晶片組成:Vera CPU、Rubin GPU、NVLink 6交換器、ConnectX-9超級網卡(SuperNIC)、BlueField-4 DPU,以及Spectrum-6乙太網交換器。

這個平台將能以4分之1的GPU數量訓練MoE模型,並將推論(inference)token 成本比Blackwell降低最多10倍。

輝達本周早些時候已將首批Vera Rubin樣品出貨給客戶,且仍維持計畫,在今年下半年開始量產出貨。

基於其模組化、免線材托盤設計,Rubin相較Blackwell將提供更佳的韌性與可維護性。我們預期每個雲端模型開發者都會部署Vera Rubin。

接著她談到遊戲(Gaming)業務。輝達上季遊戲營收達37億美元,年增47%,主要受到Blackwell強勁需求與供應改善帶動。

GeForce RTX仍是PC遊戲玩家、創作者及開發者的主要平台。

第4季度輝達新增多項技術與進展,包括DLSS 4.5,透過AI將遊戲畫面提升至新層次,以及在主流AI PC框架上,LLM推論速度提升35%。

展望未來,雖然最終產品需求持續強勁、通路庫存水位健康,但輝達預期供應限制將成為第1季及後續遊戲業務的逆風。

專業視覺化(Professional Visualization)首次突破10億美元營收,本季達13億美元,年增159%,季增74%。

輝達已在上季推出RTX Pro 5000 Blackwell工作站,配備72GB高速記憶體,專為運行LLM與代理式工作流程的AI開發者設計。

汽車業務營收為6.04億美元,年增6%,主要來自自駕解決方案需求強勁。

上月在CES,輝達推出Alpamayo,全球首個開放式組合,包含推理、視覺、語言、動作模型、模擬藍圖與數據集,賦予車輛「思考」能力。

搭載Alpamayo的首款乘用車,基於NVIDIA Drive平台打造,將很快在新款Mercedes-Benz CLA上路。

實體 AI(Physical AI)已經到來,在截至今年1月底的2026財年,已為輝達貢獻超過60億美元營收。

Robotaxi叫車服務呈指數成長,Waymo、Tesla、Uber、WeRide、Zoox以及其他多家商業車隊,預計將從2025年的數千輛擴張至未來10年的數百萬輛,創造數千億美元市場。

這樣的擴張將需要數量級更多的運算,每個主要OEM與服務供應商都在基於輝達平台開發。

輝達持續推進機器人發展,利用全新NVIDIA Cosmos與Isaac GR00T開放模型與框架,並為Boston Dynamics、Caterpillar、FANUC Robotics、LG Electronics及Neurorobotics等領先企業提供輝達驅動的機器人與自動化設備。

為加速工業實體AI採用,輝達也宣布與Dassault Systèmes、Siemens、Synopsys展開新的擴展合作,將NVIDIA AI基礎設施、Omniverse數位孿生、世界模型與 CUDA-X 函式庫,提供給全球數百萬研究員、設計師與工程師,協助他們打造世界級產業。

接著Colette Kress談損益表其餘部分。GAAP毛利率為 75%,非GAAP毛利率為75.2%,隨著Blackwell持續放量而呈逐季上升。

GAAP營運費用季增16%,非GAAP基礎上年增21%,主要與新產品導入、運算及基礎設施成本相關。

第4季度非GAAP有效稅率為15.4%,低於預期,主要因一次性稅收利益影響。

庫存季增8%,購買承諾也顯著增加,反映輝達已策略性確保庫存與產能,以滿足超過未來數季的需求。這比以往更長,顯示輝達對需求能見度提升。

雖然輝達預期先進架構供應緊張將持續,但基於輝達規模、廣泛供應鏈與長期合作夥伴關係,輝達對於抓住成長機會仍有信心。

第4季度輝達產生350億美元自由現金流,全年為970億美元。

全年輝達以股票回購與股利方式,將410億美元(約自由現金流的43%)回饋股東。輝達持續投資於技術與生態系統,以培育市場發展、推動長期成長,最終帶來超越市場或同業的總股東報酬。

Colette Kress強調,重要的是,輝達將持續以策略性與紀律化方式進行投資,並承諾持續將資本回饋股東。

接下來談到對本季展望。從本季開始,輝達將在非GAAP報表中包含股票型薪酬支出,其中包含19億美元股票型薪酬支出。股票型薪酬是我們吸引並留住世界級人才薪酬方案的核心組成。

輝達預估本季營收為780億美元上下浮動2%,並預期大部分成長將由資料中心帶動。對本季的預測未假設中國資料中心運算營收。

展望本季,GAAP與非GAAP毛利率預計分別為74.9%與75%,上下浮動50個基點。全年毛利率仍預期維持在70%中段。

黃仁勳:持續與OpenAI推進合作協議,相信雙方距離達成協議已經很接近

接著換執行長黃仁勳(Jensen Huang)說明,他表示輝達最近慶祝了OpenAI推出GPT-5.3 Codex,這套模型是在Grace Blackwell與NVLink 72 系統上訓練及推論的。GPT-5.3 Codex能處理長時間運行的任務,包括研究、工具使用與複雜操作。

5.3 Codex已經在輝達內部廣泛部署,輝達工程師非常喜愛這套工具,也持續與OpenAI推進合作協議,並相信雙方距離達成協議已經很接近。

黃仁勳表示,輝達對與OpenAI的持續合作感到興奮,這是一家千載難逢的公司,輝達有幸從他們創立初期就開始合作。

黃仁勳也說,Meta Superintelligence Labs的擴展速度非常驚人。上周輝達宣布Meta正在部署數百萬顆Blackwell與Rubin GPU、NVIDIA CPU以及Spectrum X乙太網,進行訓練與推論。

上季,輝達宣布與Anthropic建立合作夥伴關係,並對其投資100億美元。Anthropic將在Grace Blackwell與Vera Rubin系統上進行訓練與推論。

Anthropic的Claude Cowork agent平台非常具革命性,並為企業AI採用開啟了大門。結合Claude Cowork與OpenAI,運算需求正急速攀升,而ChatGPT時代的「代理式AI」已經到來。

透過Anthropic、Meta、OpenAI與xAI等合作夥伴,輝達已經部署於每個雲端,並且能從零開始打造完整的AI基礎設施堆疊,或在雲端提供支援,使輝達能在訓練、推論以及AI工廠大規模擴展的每個階段,與前沿模型開發者建立獨特的合作地位。

輝達最近也與Groq達成非授權協議,引入其低延遲推論技術,並歡迎一支才華洋溢的工程師團隊加入輝達。就像輝達過去與Mellanox的合作一樣,輝達將透過Groq的創新延伸輝達架構,實現全新層級的AI基礎設施效能與價值。

他期待在下個月的GTC分享更多進展。

今年雲端資本支出逼近7千億美元 分析師憂明年成長困難、客戶現金流受壓縮

接著開放分析師提問。第1個問題來自Bank of America Securities的Vivek Arya。

Vivek Arya問:我記得你提到,現在對2027年的成長也有可見度,我想你們的購買承諾也反映了這種信心。但請教黃仁勳,當你看你們頂級的雲端客戶,今年雲端資本支出接近7000億美元,許多投資人擔心明年這個水準要成長可能更困難,而且部分客戶的現金流也受到壓縮。

你對你們的路線圖、購買承諾非常有信心,但你對客戶能否持續成長資本支出有多大信心?如果他們的資本支出不成長,輝達還能在這個框架下找到成長方式嗎?

黃仁勳回答:我對他們現金流成長很有信心,原因非常簡單:我們已經看到代理式AI的拐點,以及代理在全球企業中展現的實用性。

你會看到因為這個新世界,運算需求非常驚人。在這個AI新世界裡,運算就等於收入。沒有運算,就無法產生token;沒有token,就無法創造收入。所以在這個新AI世界裡,運算就是收入。

關於一些策略投資,以及可能與OpenAI的合作。我們已經進入每個雲端、每個資料中心,遍布全球。Edge與數十個AI原生應用,都建立在輝達的AI生態系統上。

無論是語言AI、實體AI,或是AI物理,我們都在支持這些生態系統構建在輝達上,並在整個堆疊上持續投資。如今情況比過去更全面,輝達掌握運算的每個面向,也能進入AI模型的深層訓練,如前所述,持續擴展GPU與節點規模,每個環節都在成長。

黃仁勳:輝達機架低功耗稱霸,CUDA軟硬整合打造每瓦效能王者

黃仁勳表示,輝達的機架真的非常厲害,我們也非常喜歡它低功耗的設計,當然,有人希望將乙太網整合進人工智慧系統,而輝達在這方面的表現真的非常出色。輝達的Spectrum X性能充分展現了這一點。

當你看到Grace Blackwell與Rubin架構時,它們的底部採用雙層極限互連,這大幅降低了架構上的複雜度,比競爭對手更有效。

輝達的軟體優勢在於,很難區分軟體在哪裡開始、架構在哪裡結束。輝達的軟體之所以有效,是因為輝達的架構非常出色。CUDA架構無可置疑地更高效、更有效率,每FLOP、每瓦特的表現都很出色。未來GPU的每一代架構都會從中受益。

至於Groq,你們在GTC就會看到,我們將把Groq作為加速器,延伸輝達架構,就像我們之前與Mellanox的合作一樣。

黃仁勳談太空資料中心:現階段效益不佳,但長期可行、技術需重構

接下來花旗分析師Atif Malik問黃仁勳:能談談CUDA的重要性嗎?因為越來越多AI投資是針對推論工作負載。

黃仁勳回答:其實整個堆疊都是重要的,輝達推出的TensorRT-LLM,是最優化的推論堆疊,針對NVL做最佳化,需要我們發現並發明新的平行運算演算法,這些都建立在CUDA之上,用來分配工作負載與推論,充分利用整體資源。

這些代理式系統會衍生出不同的agent,與團隊協作,生成的token數量呈指數成長。我們必須以更高速度推論,當每個token都能直接轉換為收入時,就直接對客戶的營收產生影響。資料中心的計算量直接等同收入,每個CSP(雲端服務提供商)和hyperscaler都明白這一點。

資本支出等於運算,運算配合正確架構等於最大化收入。今天若不投資運算,就無法成長收入。這點大家都明白:運算就是收入。架構極其重要,已經不只是策略層面,直接影響盈餘。選擇最佳效能/瓦特的架構,就是一切。

接著有分析師問到:關於毛利率,長期通常維持在70%中段區間,我們是否可以理解,輝達對2027年供應可見度的掌握,代表毛利率可以維持至那時?之後呢?是否有記憶體使用效率上的創新,可以讓我們對長期維持毛利率更有信心?

財務長Colette Kress回覆,毛利率最關鍵的槓桿是持續提供客戶「世代領先」的性能,這是最重要的一點。如果我們能提供每瓦特性能顯著超越摩爾定律的提升,或每美元性能大幅超過系統成本與售價,我們就能持續維持毛利率。

原因很簡單,我們快速成長的第一因素是token的需求因為AI拐點已經呈指數成長。甚至6年前的GPU在雲端,價格都在上漲。我們知道現代軟體所需的運算量正在爆炸性增長。策略就是每年提供完整的AI基礎設施。今年推出了6顆新晶片,Rubin下一代每代都會如此。我們承諾持續提供每瓦特與每美元的多倍性能。極端共設計能力,讓我們能提供這樣的價值給客戶。這是價值交付最核心的部分。

接著黃仁勳被問到太空資料中心,他認為可行性如何?時間表與經濟效益如何?未來會怎麼演變?

黃仁勳表示,目前經濟效益不佳,但會逐步改善。太空環境與地球完全不同:能量充足,但太陽能板很大;空間多;散熱效率高,但沒有氣流,散熱只能靠導熱,散熱器需要很大。液冷不可行,太重,也不耐壓。我們地球上的方法,太空需要調整。

有很多模型想在太空做,輝達GPU Hopper也在太空。GPU在太空最適合用於高解析影像,利用光學與AI做投影、升頻與降噪,快速生成超大規模影像。將PB級資料傳回地球再處理太困難,在太空直接運算更有效,直到觀察到有趣現象再回傳。AI在太空應用會非常有趣。

非Hyperscaler成長加速?黃仁勳揭輝達生態系多元擴張新動能

接著分析師問到,hyperscaler收入超過50%,但成長主要來自其他資料中心客戶,這是否意味著非hyperscaler成長更快?他們做的事情和hyperscaler 相同嗎?未來會成為更大收入來源嗎?

黃仁勳表示,前5大CSP或hyperscaler約佔 50%。我們也與全球多樣化的AI模型開發者合作,看到各種不同類型的客戶,這種生態多樣性會帶來極大好處。

財務長Colette Kress接著說,輝達在每個雲端、邊緣、電信領域都可用,創造了Ariel平台,使自駕車等技術可行。CUDA的優勢:專用處理器性能 + GPU Tensor Core靈活性,能解決語言、電腦視覺、機器人、生命科學、物理等各種AI與運算問題。客戶多樣性是我們最大優勢之一。

生態系統也是關鍵,即使處理器可編程,如果沒有生態系統,超越設計獲勝也很難。輝達的開放原始碼合作與OpenAI、Anthropic、xAI、Meta等夥伴,使輝達平台可運行全球150萬個Hugging Face AI模型。開源生態可能是全球第2大模型平台。輝達平台高度通用、易用、安全,創造了多樣化客戶與平台,遍布每個國家。

獨立版Vera CPU將問世?黃仁勳賣關子:架構設計顛覆傳統、效能衝頂

接著富國銀行分析師Aaron Rakers提問:關於平台與極端共設計,市場有消息說輝達將推「獨立版Vera CPU」,你認為架構演進的重要性如何?是因工作負載多樣性還是異質性驅動?你如何看獨立版CPU的發展?

黃仁勳賣關子,表示這個問題會在GTC再詳細跟大家說,但從最高層級來看,輝達在CPU架構上做了根本性不同的決策,與世界上其他CPU完全不同。而且它是唯一支援LPDDR5的平台,設計重點在於極高的資料處理能力。

原因很簡單,因為輝達關注的大部分計算問題都是以資料為驅動的,人工智慧就是其中之一。而在單核心效能與頻寬比這方面,它的表現完全超乎想像。我們做出這些架構決策,是因為AI的整個流程不同階段,從資料處理開始,在真正訓練之前,你必須先處理資料。所以整個流程包含資料處理、預訓練以及後訓練階段。

現在的AI正在學習如何使用工具,而這些工具很多在純CPU環境下運行,或者在CPU+GPU加速環境下運行。Vera的設計目標就是成為後訓練階段的卓越CPU。所以在AI整個流程中,有很多場景都需要大量CPU。我們喜歡CPU,也喜歡GPU。

當你將演算法加速到極限時,就會看到Amdahl法則提醒我們:你需要非常非常快的單核心CPU,這就是我們打造Grace為單核心效能極致的原因,而Vera在這點上表現更是超越天際。

黃仁勳:token驅動新革命,AI工廠引爆3兆美元資料中心浪潮

接著有分析師問到資本部署的問題,指出輝達大幅增加了回購股票承諾,但好像已經過了高峰,預計今年現金流大約會有1000億美元,即便財報結果非常好,股價卻沒有大幅上漲,為什麼不直接大手回購一次呢?

財務長表示,輝達持續支持我們前方的極端生態系統,這包括從供應商端,到確保我們能獲得必要供應及產能,再到我們平台上AI解決方案的早期開發者。所以資本回報和策略性投資都是我們過程中非常重要的一部分。輝達仍然在進行股票回購,也維持股息,會持續尋找年度內適合的機會,進行不同形式的回購。

高盛的Jim Schneider問黃仁勳:你之前提到2030年資料中心資本支出可能達到3到4兆美元,意味著成長可能加速,你對下一季已有指引,哪些關鍵應用最可能驅動這個拐點?是物理AI、代理式AI,還是其他?你對3到4兆美元的預估仍有信心嗎?

黃仁勳說,未來的軟體使用AI都是以token為驅動,大家都在談tokenomics,資料中心生成token,推論就是生成token,而我們生成token。

以NVLink 72為例,我們比前一代每單位能量生成token的效能高50倍,幾乎所有未來軟體與運算都以token為核心,如果回顧過去,傳統軟體所需運算量只是未來需求的一小部分。而AI已經來了,而且只會越來越強。

你可以想像,過去全球在傳統運算上投入約3000–4000億美元,而現在AI來了,需要的運算量比過去高出千倍,運算需求大幅增加。如果相信這是有價值的,世界就會投資以生成這些token。換句話說,全球需要的token生成能力遠超7000億美元的傳統投資,他相當確信,這個世界將持續生成 token,也會從現在開始持續投資運算能力。

黃仁勳說明,基本上,每家公司都依賴軟體,而軟體會依賴 AI,每家公司都會生成token。這也是為什麼他稱AI工廠的原因:不論你是雲端資料中心,還是企業軟體公司,或者是機器人工廠、自駕車廠,你都有巨型超級運算機(AI工廠)生成token,進而推動你的收入。車上也要放置運算設備,持續生成token。他相當確信這是計算的未來。

為什麼這麼肯定?因為過去的軟體是預錄的,你先編譯、先寫好內容、先錄影。但現在一切都是即時生成。即時生成可以考慮使用者、情境、查詢與意圖,生成新軟體結果,我們稱之為agentic AI(代理式AI)。這需要的運算遠遠超過預錄式軟體。就像電腦比DVD播放器運算能力高一樣,AI需要比傳統軟體更多的運算能力。

在產業層面,所有公司都靠軟體驅動,雲端公司也一樣。如果新軟體需要生成token,而token可貨幣化,那資料中心的建置就直接驅動收入。換言之,運算就是收入,他們都明白這一點,也越來越多的人理解。

黃仁勳:運算等於收入 AI只會越來越強不會回頭

黃仁勳表示,AI帶來的世界效益,最終必須轉化為收入,我們現在正處於代理式AI的拐點,過去2–3個月尤為明顯。當然,業界早就觀察到這個趨勢,但全球現在都意識到代理式AI的拐點來了。這些agent超聰明、能解決真實問題。編碼也被agent系統大幅支持,輝達的工程師都在使用Claude Code、OpenAI Codex,甚至三者並行,視使用案例而定。這些agent與合作夥伴幫助解決問題,你可以看到營收飆升,例如Anthropic在1年內營收翻10倍,但產能受到極大限制,因為需求太驚人。token的需求與生成率呈指數成長,OpenAI也一樣。

因此,越多運算能上線,收入增長就越快,這也說明了他之前提的:推論就是收入,運算等於收入。在這個新世界裡,我們正見證一場新的工業革命:新工廠、新基礎建設正在建立,這種計算方式不會回頭。

輝達相信,生成token就是未來計算的方式,產業大多數也相信,從此刻起我們將持續建置運算能力並不斷擴張。現在我們看到的浪潮是代理式AI拐點,下一波拐點是物理AI,把AI與這些agent系統應用到製造、機器人等實體場景。這是一個巨大的機會。