分析|Google TurboQuant迎來DeepSeek時刻 狂砍記憶體用量!這群人受益最大

【編譯于倩若/綜合外電】隨著記憶體這類零組件價格飆漲,帶動AI(人工智慧)的成本節節攀升,Google上月提出名為TurboQuant的技術創新作為回應。TurboQuant可說是AI另一個「DeepSeek時刻」,是一項大幅降低AI成本的深層嘗試,可能透過減少AI的記憶體使用量帶來長遠效益,讓模型變得更有效率。

TurboQuant問世後,全球記憶體股經歷了大跌及劇烈震盪。針對不斷飆升的AI成本,它「能」與「不能」帶來哪些改變?《知新聞》帶您一文看懂。

Google TurboQuant 技術關鍵數據與影響分析

📌 本文摘要重點

(AI 摘要說明)效率越高、投資越多?TurboQuant與「傑文斯悖論」下的AI發展

即便如此,就像DeepSeek並沒有阻止對AI晶片的大量投資,觀察人士認為TurboQuant很可能反而會讓AI投資持續成長。這正是所謂的「傑文斯悖論」(Jevons paradox),也就是當某樣東西變得更有效率時,反而會讓整體使用量增加。

不過,TurboQuant這種方法,確實有機會透過降低大型語言模型對硬體的需求,讓AI更容易在本地端運行。

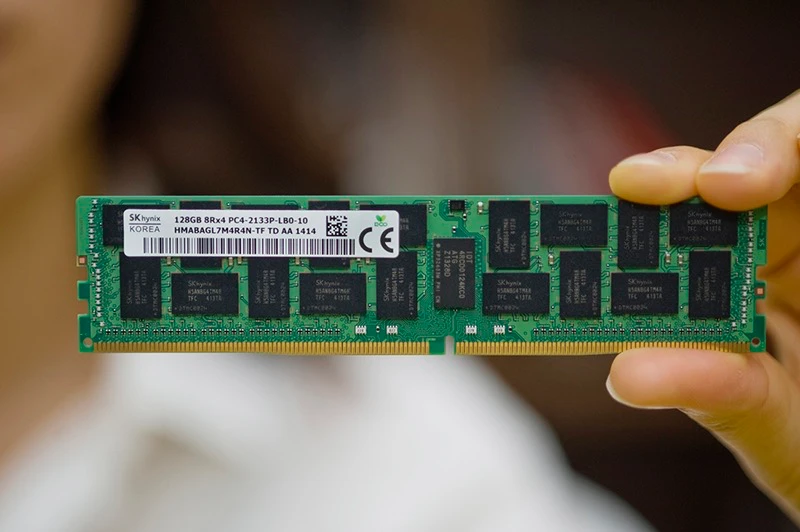

記憶體越多,成本越高

據《ZDNET》報導,目前AI最大成本來源,而且在可預見的未來很可能仍是如此,就是對記憶體與儲存技術的需求持續增加。AI極度依賴資料,讓記憶體與儲存的重要性達到電腦史上前所未有的程度。

TurboQuant最早是在1年前由Google研究人員於論文中提出,它運用量化(quantization)技術,來減少表示資料所需的位元數。量化本質上是一種資料壓縮,用更少的位元來表示相同的數值。

《ZDNET》資深科技記者Tiernan Ray指出,在TurboQuant的情境中,重點放在所謂「鍵值快取」(key-value cache,簡稱KV cache),這是AI系統中最吃記憶體的部分之一。

在對Google Gemini這樣的聊天機器人輸入文字時,AI必須把你的輸入與一組類似資料庫的參考資料進行比對。輸入的內容稱為查詢(query),會與記憶體中的資料(稱為鍵,key)做比對,找出數值上的匹配程度,本質上就是一個「相似度分數」。接著系統會利用這個key,從記憶體中取出對應的內容(稱為值,value),也就是最後回覆給你的文字。

一般情況下,每次輸入時,AI模型都必須重新計算新的key和value,這會拖慢整體速度。為了加快處理,系統會把最近用過的key和value存在記憶體中的KV cache。

但這個快取本身也會變成問題:你使用模型越多,KV cache就會佔用越多記憶體。Google的主要作者Amir Zandieh與團隊指出,這種擴張在記憶體使用與運算速度上都是重大瓶頸,尤其對於長上下文模型更是如此。

更麻煩的是,AI模型的key與value變得越來越複雜,也就是所謂的「上下文視窗」(context window)越來越大。這讓模型有更多搜尋選項,理論上能提升準確度。例如目前版本的Gemini 3已將上下文視窗提升到100萬tokens,而像OpenAI的GPT-4這類先前的先進模型,只有將近3.28萬tokens。

但上下文視窗越大,KV cache需要的記憶體也會跟著暴增。

讓量化可以即時運作

解決KV cache膨脹的方法,就是對key和value進行量化,讓整體佔用空間變小。Amir Zandieh團隊在部落格中表示,TurboQuant的壓縮效果是「非常巨大」的。他們強調:「在不犧牲準確度的前提下縮小KV cache,至關重要。」

《ZDNET》指出,量化其實早就被Google等公司用來精簡神經網路,但TurboQuant的新意在於,它可以「即時量化」。過去的方法是在模型部署前(編譯階段)就先壓縮好,但這樣並不夠。

因為KV cache是在推論階段持續更新的,也就是使用者與AI互動時,key和value會不斷改變。因此量化必須又快又準,才能一邊維持小體積,一邊保持資料最新。

TurboQuant裡的「Turbo」就是在強調,它比傳統編譯時量化快得多。

2階段處理方式

TurboQuant採用2個階段:

第1階段,壓縮query和key。這可以用幾何方式來做,因為它們本質上是向量,可以在X-Y平面上表示成一條線並進行旋轉。這個方法稱為「PolarQuant」。

透過隨機嘗試不同的旋轉方式,再還原回原始向量,他們找到能維持準確度但使用更少位元的表示法。

不過,壓縮後的向量在做query與key的比對時,仍會產生誤差,因此他們加入第2個方法 QJL。QJL的做法是保留其中一個向量不壓縮,作為提升準確度的校正機制。

測試成果:準確度不變、記憶體砍6倍

研究團隊將TurboQuant套用在Meta開源模型Llama 3.1-8B上,結果顯示:

在所有測試指標中都維持完整準確度,同時將KV cache的記憶體需求縮小至少6倍。這代表快取需求直接減少到原本的6分之1。

與其他壓縮KV cache的方法(例如DeepSeek去年透過限制搜尋範圍來加速推論)相比,TurboQuant的做法不同。

在另一組測試中,使用Google的Gemma模型以及法國AI新創Mistral的模型,結果顯示:

TurboQuant可以把KV cache量化到僅3 bits,而且不需要重新訓練或微調,也不會影響模型準確度,同時執行速度還比原始模型更快。

研究人員表示,這種方法「實作非常高效,執行時幾乎沒有額外負擔」。

AI會變便宜嗎?分析師指TurboQuant只會讓AI的使用更有效率,而不是降低總需求

Amir Zandieh團隊認為,TurboQuant對AI推論在實際產品中的應用會有重大影響。他們指出,隨著AI被整合進各種產品(從大型語言模型到語意搜尋),這種基礎的向量量化技術,將變得越來越關鍵。

在代理型AI(agentic AI)的時代,像OpenClaw這類可以自主運作的程式,AI的效能不只取決於KV cache。像資料庫讀寫等其他記憶體操作,也會影響長期效率。

不過,關注AI晶片市場的人士指出,就像DeepSeek的效率提升沒有減緩AI投資一樣,TurboQuant也不太可能改變這個趨勢。

美銀美林科技分析師Vivek Arya在寫給客戶的報告中表示,TurboQuant只會讓AI的使用更有效率,而不是降低總需求。他寫道:「記憶體效率提升6倍,很可能會轉化為模型規模(準確度)或上下文長度(KV cache配置)提升6倍,而不是記憶體需求下降6倍。」

本地部署一大福音:TurboQuant讓MacBook Neo與Mac mini也能打造平價AI伺服器

不過,TurboQuant確實能讓某些AI應用變得更省成本,特別是在本地部署的情境下。

舉例來說,當KV cache持續膨脹、上下文視窗變長時,如果是在硬體預算有限的環境中執行AI模型,這些負擔會變得比較可控。

這對想用MacBook Neo或Mac mini這類設備,來打造平價本地AI伺服器的OpenClaw使用者來說,會是一大福音。