廣告

震撼!輝達將砸逾8200億開發開源AI模型 首批最快今年底問世

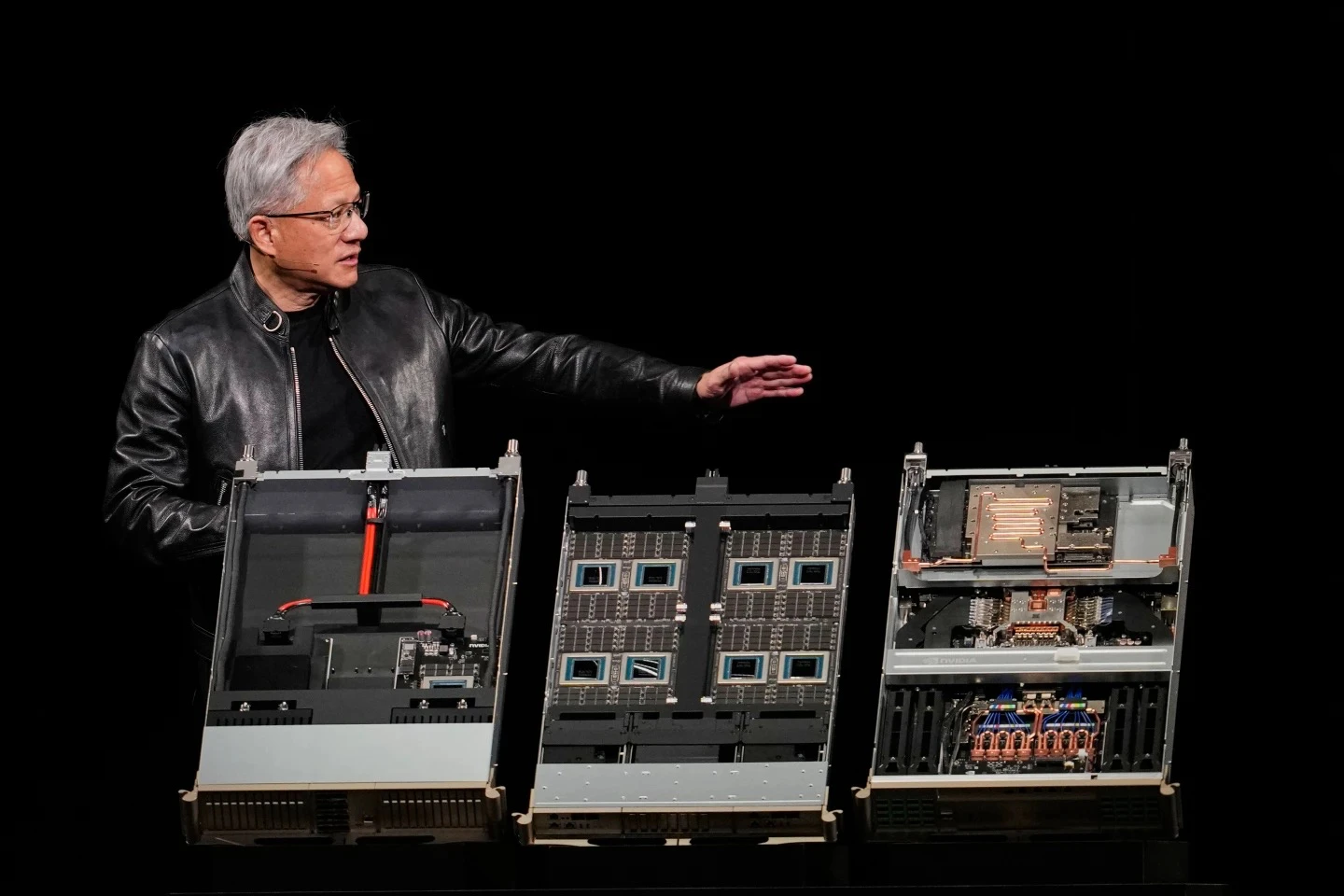

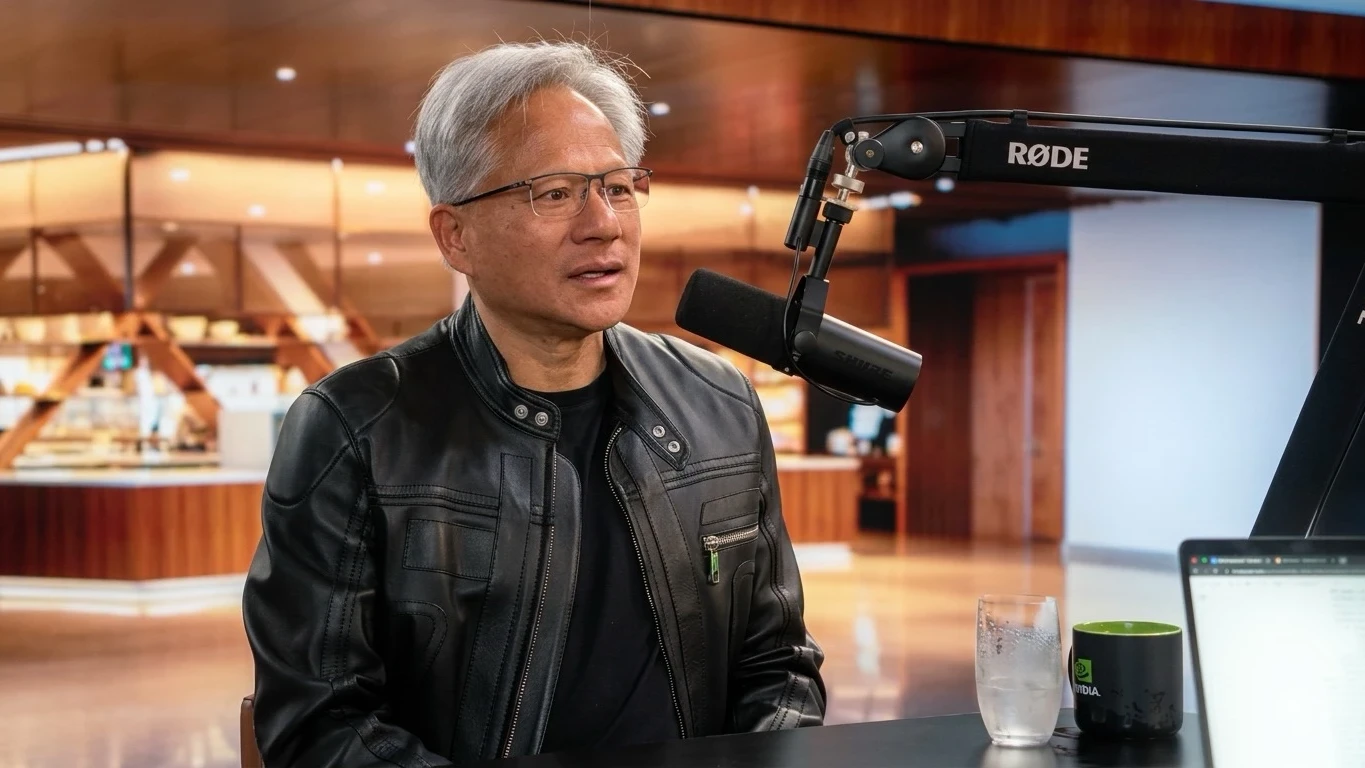

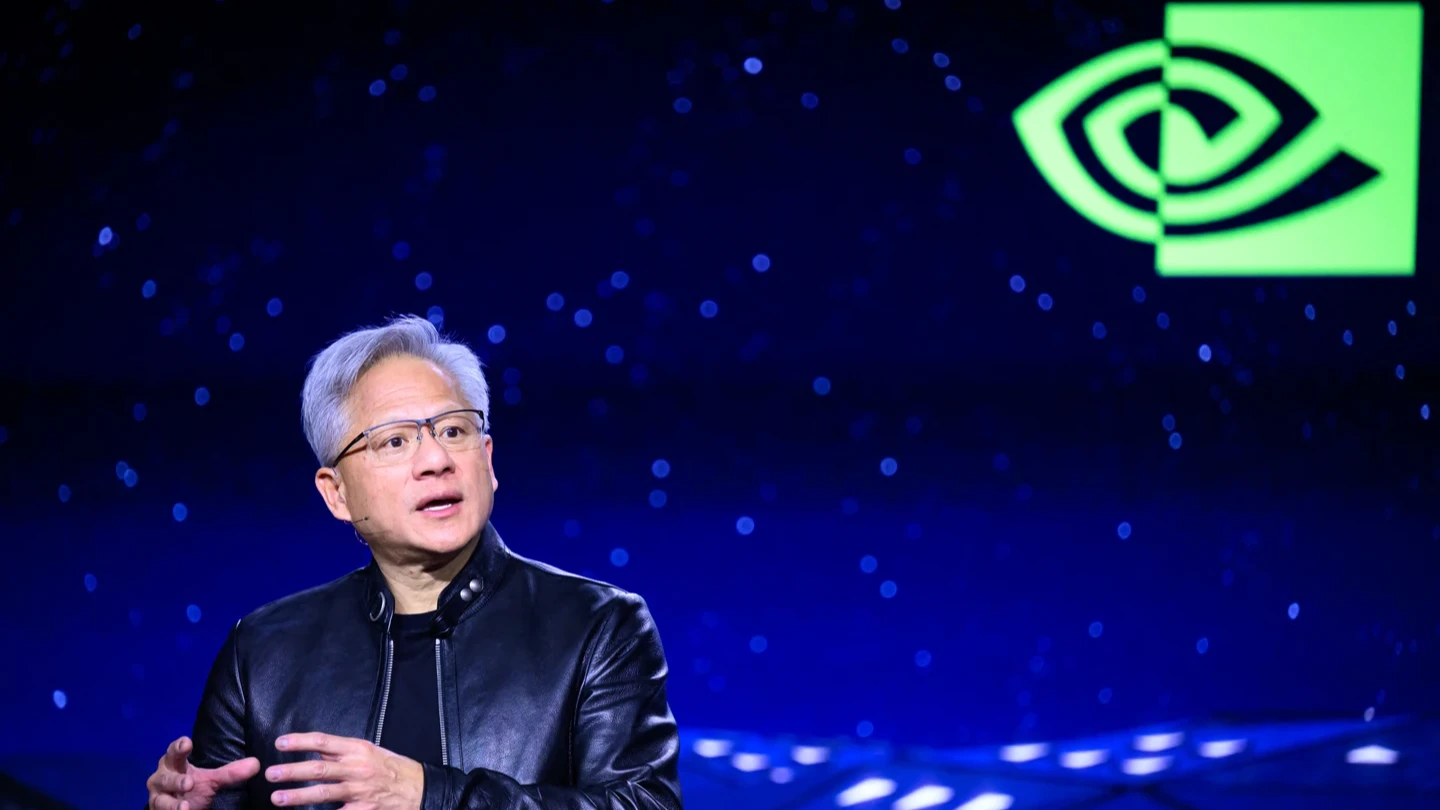

【財經中心╱台北報導】國外媒體連線(Wired)今天報導,輝達宣布將在未來5年時間內,投資260億美元(約8263億台幣)開發開源AI模型Nemotron 3 Super,並解釋認為輝達開始戰略轉型,從純頂晶片製造商邁向頂尖AI實驗室。

連線認為,輝達正從一家擁有強大軟體生態的晶片製造商,演變為能夠與OpenAI、DeepSeek全面抗衡的頂尖AI前沿實驗室。由於這些自研模型將深度優化其自家硬體,此舉將進一步鞏固輝達在AI晶片領域的霸主地位。

在技術路線上,輝達選擇一條中間道路。所謂開放權重,即公開模型參數權重,但不一定採用完全開源的許可協議。

Nemotron 3 Super是輝達最強大開源權重模型

Nemotron 3 Super是輝達最強大的開源權重AI模型,模型擁有1200億參數,採用混合專家(MoE)架構(推理時僅激活120 億),專為大規模運行複雜代理式AI(Agentic AI)系統設計。

該模型結合先進推理能力,能夠為自主智慧能體高精度地完成任務。Perplexity、Palantir和西門子等行業巨頭已將其應用於搜尋、軟體開發、電信和半導體設計等核心工作流程。隨著企業將AI應用從聊天機器人轉向代理式AI,往往面臨兩大瓶頸:「上下文爆炸」與「推理稅」。代理式AI互動會產生最多15倍的Token量,導致成本飆升和目標偏移;同時,複雜代理式AI每步都需要推理,讓系統變得昂貴且遲鈍。

Nemotron 3 Super為解決這些問題,配備100萬Token的上下文視窗,這讓代理式AI能夠將完整的工作流程狀態保留在記憶體中,從而防止目標偏移,並大幅降低多步驟推理的成本。

在架構與效能方面,該模型採用了混合專家(MoE)架構,將吞吐量提升5倍,準確率比前代翻倍。具體而言,其Mamba 層使記憶體和運算效率提高4倍,而Transformer 層則負責高階推理。

未來每年可望貢獻500億美元營收

開源權重模型(Open-weight AI models)指將決定AI模型行為的關鍵參數(權重)向公眾免費開放的模型,與完全閉源的模型(如GPT-4)不同,開發者可以下載並在自己的裝置上運行或微調這些模型。

報導指出,這項策略既不同於OpenAI的封閉模式,也有別於Meta旗下Llama系列的完全開源。企業目前亟需具備透明度且可客製化的模型,若輝達能推出針對其硬體優化的開放權重模型,必將構築起強大的技術護城河。

這筆260億美元的巨資將全面涵蓋模型開發、算力基礎設施、研究人才儲備以及生態系統建設。作為對比,OpenAI訓練GPT-4的耗資僅約30億美元。這意味著,憑藉自身掌控的核心算力資源與過去2年秘密組成的研發團隊,輝達擁有充裕的預算來開發多個前沿大模型。

文件顯示,相關資金投入將在未來18至24個月內逐步落實,預計首批模型將於2026年底或2027年初問世。分析師預測,若輝達在維持硬體霸主地位的同時拿下基礎模型10%市佔,3年內可望每年增收500億美元。